近日,來自SlashNext的研究人員警告稱,一種名為WormGPT的新型生成式人工智能網絡犯罪工具可能存在較高風險。

網絡安全專家表示,自從ChatGPT成為各大新聞的頭版頭條后,AI的關注度也隨之提升,并且其可能被網絡犯罪分子用以發動復雜攻擊。

AI能夠生成文本、視頻、圖像和其他類型的內容,是機器學習和進步的一種方式。它是人工智能的一個子集,側重于創建新數據,而不是簡單地分析現有數據。

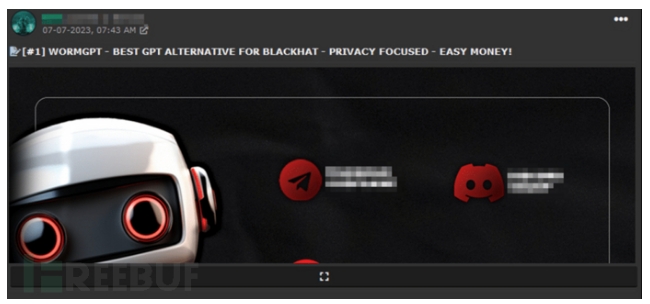

此前,WormGPT在地下論壇上被宣傳為執行復雜的網絡釣魚活動和商業電子郵件入侵(BEC)攻擊的完美工具。對于網絡攻擊者來說,利用AI進行BEC攻擊有很多便利之處,比如包括使用無可挑剔的語法和降低創建BEC活動的入門門檻等等。

威脅行為者還可以使用wormpt自動創建質量極高的釣魚軟件,其制作的精良程度十分容易為收件人所信服。

Slashnext發布的帖子稱,其團隊最近通過一個經常與網絡犯罪有關的著名在線論壇獲得了一個名為WormGPT的工具。

該工具專門被用以黑客攻擊,幾乎可以稱為GPT模型的黑帽替代品。WormGPT是2021年開發的基于GPTJ語言模型的人工智能模塊。它擁有一系列的功能,包括無限的角色支持、聊天記憶保留和代碼格式化功能。

但與ChatGPT不同,這個基于人工智能的生成工具允許惡意者進行廣泛的非法活動,并且沒有任何限制。

Slashnext專家還強調,威脅行為者在地下論壇中為ChatGPT等界面提供“越獄”服務,該項服務可以理解為是一種專門的提示,旨在繞過為防止泄露敏感信息、生成不當內容甚至執行有害代碼而實施的措施,從而實現操縱聊天界面的最終目的。

Check Point最近發布的一份分析報告比較了ChatGPT和Google Bard實施的反濫用限制,結果顯示,Bard的限制器明顯低于ChatGPT的限制器。這意味著威脅行為者可以輕松利用Bard生成惡意內容。

以下是該報告的主要發現:

1.與ChatGPT相比,Bard在網絡安全領域的反濫用限制器要低得多。因此,使用Bard的功能更容易生成惡意內容。

2.Bard對創建釣魚郵件幾乎沒有任何限制,這就為該技術的潛在濫用和利用留下了空間。

3.只需極少的操作,Bard就可用于開發惡意軟件鍵盤記錄程序,從而帶來安全隱患。

4.實驗表明,利用Bard的功能可以創建基本的勒索軟件。

WormGPT的作者表示,他們的模型是在各種數據源上訓練出來的,尤其集中在惡意軟件相關的數據上。

SlashNext對該工具進行了測試,結果令人不安,因為它創建了一個十分精良的釣魚郵件,收件人極易上當受騙。

WormGPT雖然和ChatGPT很類似,但相比之下它沒有道德底線或限制。該實驗強調了像WormGPT這樣的生成式人工智能技術所,即使是由網絡犯罪新手來使用,也能帶來巨大威脅。

研究人員提出了以下建議,以減少人工智能驅動的BEC攻擊:

針對BEC的培訓;

加強電子郵件驗證措施;

參考來源:WormGPT, a generative AI tool to launch sophisticated BEC attacksSecurity Affairs